Les chercheurs discutent de la nécessité d’une réglementation fédérale pour lutter contre les risques associés à la technologie dans les soins de santé.

La plupart des adultes américains utilisent la technologie pour améliorer leur santé : près de 60 % d’entre eux consultent Internet pour obtenir des informations médicales et plus de 40 % obtiennent des soins par télémédecine. Malgré le potentiel de la technologie en matière de soins de santé, six Américains sur dix ne sont pas à l’aise avec le fait que leur prestataire de soins de santé s’appuie sur l’IA pour diagnostiquer des maladies et recommander des traitements.

L’IA peut améliorer la qualité des soins en aidant les médecins à vérifier leurs diagnostics et à détecter les maladies plus tôt. Par exemple, des chercheurs ont découvert que la technologie de l’IA peut aider à prédire le risque de cancer du sein d’une patiente. De même, une combinaison de l’expertise des médecins et des algorithmes d’IA peut augmenter la précision des diagnostics.

Pourtant, les systèmes d’IA peuvent échouer, et si les humains s’appuient trop sur les logiciels, un problème sous-jacent dans un algorithme peut blesser plus de patients que l’erreur d’un seul médecin. De plus, les algorithmes d’IA intègrent les biais des données disponibles. Par exemple, les patients noirs reçoivent en moyenne moins d’analgésiques que les patients blancs. Un algorithme formé pour recommander un traitement contre la douleur à partir de ces dossiers de santé pourrait suggérer des doses plus faibles d’analgésiques pour les patients noirs, quels que soient leurs besoins biologiques.

Dans le même temps, la technologie peut aider les communautés mal desservies à accéder aux soins de santé. Ces communautés connaissent souvent une pénurie de praticiens qualifiés et d’établissements de soins de santé standards, ce qui entraîne un risque plus élevé de maladies et d’erreurs de diagnostic. La télésanté, par exemple, améliore l’accès à des soins de qualité en permettant aux patients de rencontrer des médecins en ligne ou de faire surveiller leurs signes vitaux à distance.

Actuellement, aucune loi fédérale ne réglemente l’utilisation de l’IA dans les soins de santé. Bien que la Food and Drug Administration (FDA) des États-Unis examine la plupart des produits utilisant une technologie ou un logiciel d’IA sur les patients, elle ne détermine pas actuellement si l’utilisation de l’IA dans les soins de santé est sans danger pour les patients. Au lieu de cela, la FDA approuve les appareils compatibles avec l’IA via un processus connu sous le nom d’examen 510(k). Lors d’un examen 510(k), un fabricant doit démontrer que sa technologie est « substantiellement équivalente » à un produit déjà disponible sur le marché. Le processus permet aux appareils compatibles avec l’IA d’être approuvés sans essais cliniques prouvant leur sécurité ou leur précision.

L’année dernière, l’administration Biden s’est engagée à superviser le développement responsable de l’IA, y compris dans les domaines liés à la santé. Le décret du président Joseph R. Biden sur le sujet exige que les prestataires de soins de santé informent les utilisateurs lorsque le contenu qu’ils fournissent est généré par l’IA et n’est pas examiné par un médecin. En outre, les prestataires sont responsables d’atténuer les risques potentiels posés par la technologie et de veiller à ce qu’elle élargisse l’accès aux soins.

Les professionnels de la santé ont également exprimé leur inquiétude quant au fait que les adolescents diagnostiquent eux-mêmes leurs problèmes de santé évoqués par les influenceurs qui font la promotion de la télémédecine sur les réseaux sociaux. Actuellement, la FDA n’exige pas que les sociétés de télémédecine divulguent des informations sur les risques potentiels des services, et les sociétés bénéficient de protections en matière de liberté d’expression en tant que « annonceurs ».

Les partisans d’une réglementation plus stricte de la technologie dans les soins de santé soulignent que les prestataires de télésanté échappent à la réglementation en se présentant comme des plateformes de communication reliant les patients aux médecins, et non comme des prestataires de services médicaux. Les entreprises de télésanté conservent leur indépendance vis-à-vis des prestataires médicaux, ce qui leur permet d’éviter toute responsabilité légale pour les actions de ces prestataires.

Lors du séminaire du samedi de cette semaine, les universitaires proposent diverses suggestions sur la réglementation de l’utilisation de la technologie dans les soins de santé.

- Les algorithmes d’IA sont intrinsèquement biaisés, mais aucune réglementation fédérale ne traite du risque de diagnostics biaisés lorsque l’IA est utilisée dans les soins de santé, affirme Natalie Shen, récente diplômée de la faculté de droit de l’Université de Seattle, dans un article du Journal de Seattle sur le droit de la technologie, de l’environnement et de l’innovation. Shen explique qu’en l’absence d’action fédérale, les États ont pris l’initiative d’adopter des lois pour lutter contre les systèmes de décision automatisés tels que l’IA dans les soins de santé. En analysant les approches du New Jersey et de la Californie, Shen recommande des améliorations à la future législation des États, notamment en étendant la couverture de toute future loi au secteur de l’assurance maladie privée et en imposant des exigences d’évaluation continue à mesure que la technologie de l’IA évolue.

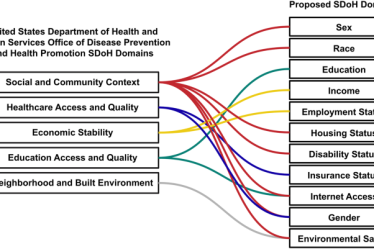

- Dans un article pour le Revue du droit de Virginie, Khiara M. Bridges, de la faculté de droit de Berkeley, soutient que l’éducation des patients sur le risque de biais algorithmiques fondés sur la race devrait être une condition préalable avant d’utiliser l’IA dans les soins de santé. Bridges explique que les personnes de couleur sont plus susceptibles de se méfier des médecins et des établissements de santé et sont donc susceptibles d’être sceptiques à l’égard de l’IA médicale. De plus, les algorithmes médicaux sont développés sur la base d’une « population générale » principalement blanche, ce qui réduit leur précision prédictive pour les communautés de couleur, note Bridges. Elle soutient que la divulgation des risques liés à l’IA favoriserait le dialogue patient-médecin dans les communautés de couleur, encourageant davantage de patients de couleur à utiliser la technologie et, à terme, corrigeant les biais algorithmiques existants.

- La réglementation des outils de santé basés sur l’IA doit inclure des processus d’autorisation préalable à la commercialisation et de surveillance continue des performances, exhortent Joana Gonçalves-Sá du Complexity Science Hub et Flávio Pinheiro de la NOVA Information Management School dans un chapitre de Perspectives multidisciplinaires sur l’intelligence artificielle et le droit. Gonçalves-Sá et Pinheiro proposent des améliorations au programme pilote de la FDA, Total Product Lifecycle, qui suit les risques de sécurité de l’IA. Dans le cadre de ce programme, une entreprise d’IA peut obtenir un « statut précertifié » si elle peut démontrer qu’elle développe des algorithmes de haute qualité et continue de surveiller leur efficacité après son entrée sur le marché, expliquent Gonçalves-Sá et Pinheiro. La FDA devrait également étudier la fiabilité des ensembles de données et des ingénieurs qui forment les outils d’IA, recommandent Gonçalves-Sá et Pinheiro.

- Les régulateurs devraient abaisser les barrières juridiques qui empêchent les organisations communautaires telles que les églises noires d’aider les personnes pauvres et marginalisées à accéder aux services de télésanté, affirme Meighan Parker de la faculté de droit de l’Université de Chicago dans un article récent paru dans la revue Revue du droit de la science et de la technologie de Columbia. Parker note que même si les organisations communautaires telles que les églises noires pourraient aider certaines personnes à surmonter la méfiance à l’égard des prestataires de soins de santé, leur implication pourrait provoquer des conflits entre les croyances des églises et les besoins médicaux des patients, ou exposer les églises à des responsabilités pour faute professionnelle. En réponse, Parker propose d’assouplir ou d’ajuster les barrières réglementaires pour garantir que les églises ne seront pas confrontées à des conflits éthiques ou à des responsabilités juridiques pour connecter les personnes aux services de télésanté nécessaires.

- Dans une note dans le Journal de Washington sur le droit, la technologie et les arts, Kaitlin Campanini, étudiante à la faculté de droit Elisabeth Haub de l’Université Pace, affirme que la réglementation laxiste des prestataires de télésanté par la Drug Enforcement Administration des États-Unis a aggravé l’inadéquation des traitements de santé mentale et augmenté les prescriptions excessives de médicaments. Bien que les modèles commerciaux des prestataires de télésanté puissent rendre le traitement plus pratique et abordable, le modèle de traitement accéléré qu’ils proposent « brouille la frontière entre l’offre de soins de santé aux patients et la vente de substances contrôlées aux clients ». En effet, ces entreprises tombent dans une zone grise réglementaire. Ils refusent de fournir des services médicaux en affirmant qu’ils sont indépendants des prestataires. Pourtant, ils commercialisent de manière agressive des stimulants auprès des consommateurs et facilitent les prescriptions douteuses après de courtes évaluations virtuelles.

- Dans une note récente dans le Revue de droit Belmont, la candidate du JD, Nora Klein, soutient que les régulateurs devraient combler les lacunes juridiques qui permettent aux sociétés pharmaceutiques de vente directe au consommateur (DTC) d’influencer injustement les utilisateurs des médias sociaux. Klein note que les sociétés pharmaceutiques de la DTC ont évité les réglementations publicitaires de la FDA en partie en se présentant comme des entités sur lesquelles la FDA n’a aucune autorité réglementaire. En conséquence, ces entités ne sont soumises qu’aux réglementations publicitaires de la FTC, qui sont difficiles à appliquer, observe Klein. Elle soutient que le modèle DTC est néfaste car il entraîne des erreurs de diagnostic et des complications pour les patients plus souvent que les services de soins de santé traditionnels. Pour résoudre le problème, Klein propose que la FDA oblige les sociétés pharmaceutiques DTC à divulguer des informations importantes sur les médicaments aux consommateurs.

Le séminaire du samedi est une émission hebdomadaire qui vise à mettre par écrit le type de contenu qui serait transmis lors d’un séminaire en direct impliquant des experts en réglementation. Chaque semaine, L’examen de la réglementation publie un bref aperçu d’un sujet réglementaire sélectionné, puis distille des recherches récentes et des écrits scientifiques sur ce sujet.

Archie Mitchell, with a prestigious master’s degree from France and two decades of experience, is an authority in his field, renowned for making complex subjects engaging through his blog. At 49, he seamlessly merges academic knowledge with practical insights, aimed at educating and empowering his audience. Beyond his professional life, Archie’s hobbies and personal interests add depth to his writing, making it a valuable resource for both professionals and enthusiasts looking to expand their understanding.